Scrapy对比Selenium:哪个最适合您的网络爬虫项目

Emma Foster

Machine Learning Engineer

网络爬虫是从互联网收集数据的重要技术,它在开发者、研究人员和企业中越来越受欢迎。Scrapy和Selenium是两种最常用的网络爬虫工具。每种工具都有其优缺点,适用于不同类型的项目。在本文中,我们将比较Scrapy和Selenium,帮助您确定哪种工具最适合您的网络爬虫需求。

目录

- 简介

- 什么是Scrapy

- Scrapy的组件

- Scrapy项目的基本工作流程

- 什么是Selenium

- Selenium WebDriver的主要特性

- Scrapy和Selenium的比较

- 在Scrapy和Selenium之间选择

- 使用Scrapy和Selenium的挑战

- 结论

什么是Scrapy

Scrapy是一个强大而快速的开源网络爬虫框架,使用Python编写。它专为抓取网页和从中提取结构化数据而设计。Scrapy高效、可扩展且可定制,是大规模网络爬虫项目的绝佳选择。

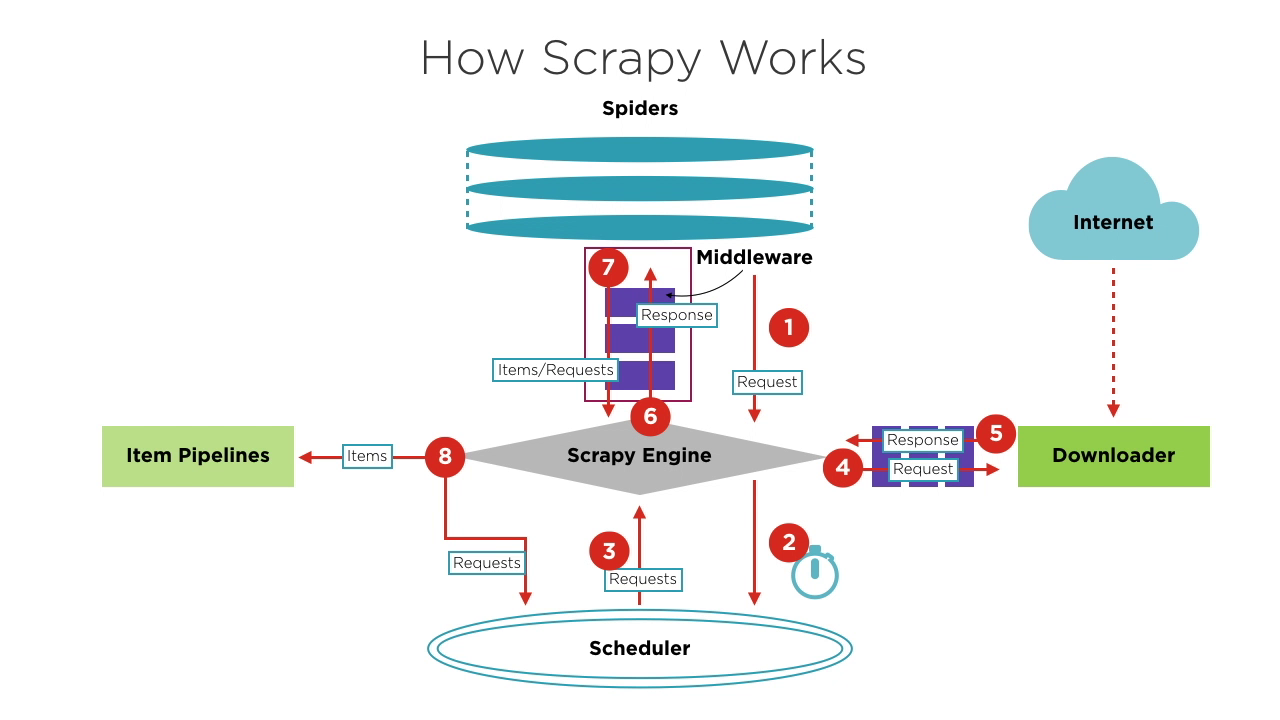

Scrapy的组件

- Scrapy引擎: 框架的核心,管理系统内的数据流和事件。它就像大脑,处理数据传输和逻辑处理。

- 调度器: 接收来自引擎的请求,将它们排队,并将它们发送回引擎以供下载器执行。它维护调度逻辑,如FIFO(先进先出)、LIFO(后进先出)和优先级队列。

- 蜘蛛: 定义抓取和解析页面的逻辑。每个蜘蛛负责处理响应,生成项目,并向引擎发送新的请求。

- 下载器: 处理向服务器发送请求并接收响应,然后将响应发送回引擎。

- 项目管道: 处理由蜘蛛提取的项目,执行数据清理、验证和存储等任务。

- 中间件:

- 下载器中间件: 位于引擎和下载器之间,处理请求和响应。

- 蜘蛛中间件: 位于引擎和蜘蛛之间,处理项目、请求和响应。

反复失败解决烦人的验证码让你头疼不已?使用CapSolver的AI驱动自动网页解锁技术,体验无缝的自动验证码解决方案!

领取您的验证码解决方案优惠码;CapSolver: WEBS。兑换后,每次充值都可获得额外5%的奖励,无限制

Scrapy项目的基本工作流程

-

当开始一个爬取项目时,引擎根据要爬取的网站找到处理该网站的蜘蛛。蜘蛛生成一个或多个对应于需要爬取的页面的初始请求,并将它们发送给引擎。

-

引擎从蜘蛛获取这些请求,然后将它们传递给调度器等待调度。

-

引擎向调度器请求下一个要处理的请求。此时,调度器根据其调度逻辑选择一个适当的请求,并将其发送给引擎。

-

引擎将调度器的请求转发给下载器执行下载。将请求发送给下载器的过程会经过许多预定义的下载器中间件的处理。

-

下载器将请求发送到目标服务器,接收相应的响应,然后将其返回给引擎。将响应返回给引擎的过程也会经过许多预定义的下载器中间件的处理。

-

引擎从下载器接收到的响应包含目标网站的内容。引擎将这个响应发送给相应的蜘蛛处理。将响应发送给蜘蛛的过程会经过预定义的蜘蛛中间件的处理。

-

蜘蛛处理响应,解析其内容。此时,蜘蛛会产生一个或多个爬取结果项目,或者一个或多个对应于后续要爬取的目标页面的请求。然后它将这些项目或请求发送回引擎处理。将项目或请求发送给引擎的过程会经过预定义的蜘蛛中间件的处理。

-

引擎将蜘蛛发回的一个或多个项目转发给预定义的项目管道进行一系列的数据处理或存储操作。它将蜘蛛发回的一个或多个请求转发给调度器等待下一次调度。

步骤2到8会重复进行,直到调度器中没有更多的请求。此时,引擎将关闭蜘蛛,整个爬取过程结束。

从整体来看,每个组件只专注于一个功能,组件之间的耦合度非常低,非常容易扩展。然后引擎将各个组件组合在一起,让每个组件各司其职,相互配合,共同完成爬取工作。此外,借助Scrapy对异步处理的支持,它可以最大限度地利用网络带宽,提高数据爬取和处理的效率。

什么是Selenium?

Selenium是一个开源的Web自动化工具,允许您以编程方式控制Web浏览器。虽然它主要用于测试Web应用程序,但Selenium也因为能够与重度JavaScript网站交互而在Web爬虫中广受欢迎,这些网站使用传统方法难以爬取。需要注意的是,Selenium只能测试Web应用程序。我们不能使用Selenium来测试任何桌面(软件)应用程序或移动应用程序。

Selenium的核心是Selenium WebDriver,它提供了一个编程接口,允许开发人员编写代码来控制浏览器的行为和交互。这个工具在Web开发和测试中非常受欢迎,因为它支持多种浏览器,并且可以在不同的操作系统上运行。Selenium WebDriver允许开发人员模拟用户在浏览器中的操作,如点击按钮、填写表单和导航页面。

Selenium WebDriver提供了丰富的功能,使其成为Web自动化测试的理想选择。

Selenium WebDriver的主要特性

-

浏览器控制: Selenium WebDriver支持多种主流浏览器,包括Chrome、Firefox、Safari、Edge和Internet Explorer。它可以启动和控制这些浏览器,执行诸如打开网页、点击元素、输入文本和截图等操作。

-

跨平台兼容性: Selenium WebDriver可以在不同的操作系统上运行,包括Windows、macOS和Linux。这使得它在多平台测试中非常有用,允许开发人员确保他们的应用程序在各种环境中表现一致。

-

编程语言支持: Selenium WebDriver支持多种编程语言,包括Java、Python、C#、Ruby和JavaScript。开发人员可以选择他们熟悉的语言来编写自动化测试脚本,从而提高开发和测试效率。

-

Web元素交互: Selenium WebDriver提供了丰富的API来定位和操作网页元素。它支持通过ID、类名、标签名、CSS选择器、XPath等各种方法来定位元素。开发人员可以使用这些API来实现点击、输入、选择、拖放等操作。

Scrapy和Selenium的比较

| 特性 | Scrapy | Selenium |

|---|---|---|

| 用途 | 仅用于网络爬虫 | 网络爬虫和网络测试 |

| 语言支持 | 仅Python | Java、Python、C#、Ruby、JavaScript等 |

| 执行速度 | 快 | 较慢 |

| 可扩展性 | 高 | 有限 |

| 异步支持 | 是 | 否 |

| 动态渲染 | 否 | 是 |

| 浏览器交互 | 否 | 是 |

| 内存资源消耗 | 低 | 高 |

在Scrapy和Selenium之间选择

-

选择Scrapy 如果:

- 您的目标是没有动态渲染的静态网页。

- 您需要优化资源消耗和执行速度。

- 您需要广泛的数据处理和自定义中间件。

-

选择Selenium 如果:

- 您的目标网站涉及动态内容并需要交互。

- 执行效率和资源消耗不是主要考虑因素。

是使用Scrapy还是Selenium取决于具体的应用场景,比较各种优缺点,选择最适合您的,当然,如果您的编程技能足够强,您甚至可以同时结合Scrapy和Selenium。

使用Scrapy和Selenium的挑战

无论使用Scrapy还是Selenium,您可能都会遇到同样的问题:机器人挑战。机器人挑战被广泛用于区分计算机和人类,防止恶意机器人访问网站,并保护数据不被抓取。常见的机器人挑战包括captcha、reCaptcha、captcha、captcha、Cloudflare Turnstile、captcha、captcha WAF等。它们使用复杂的图像和难以阅读的JavaScript挑战来判断您是否是机器人。有些挑战甚至连人类都难以通过。

俗话说,"术业有专攻"。CapSolver的出现使这个问题变得更简单。CapSolver使用基于AI的自动网页解锁技术,可以在几秒钟内帮您解决各种机器人挑战。无论您遇到什么样的图像或问题挑战,都可以放心地交给CapSolver。如果不成功,您不会被收费。

CapSolver提供了一个浏览器扩展,可以在您基于Selenium的数据抓取过程中自动解决CAPTCHA挑战。它还提供了一种API方法来解决CAPTCHA并获取令牌,让您也可以轻松处理Scrapy中的各种挑战。所有这些工作都可以在几秒钟内完成。更多信息请参考CapSolver文档。

结论

在Scrapy和Selenium之间的选择取决于您项目的需求。Scrapy非常适合高效地抓取静态网站,而Selenium在处理动态的、重度JavaScript页面方面表现出色。考虑具体要求,如速度、资源使用和交互级别。对于克服CAPTCHA等挑战,CapSolver等工具提供了高效的解决方案,使抓取过程更加顺畅。最终,正确的选择可以确保成功和高效的抓取项目。